This is a guided project on fine-tuning a Bidirectional Transformers for Language Understanding (BERT) model for text classification with TensorFlow. In this 2.5 hour long project, you will learn to preprocess and tokenize data for BERT classification, build TensorFlow input pipelines for text data with the tf.data API, and train and evaluate a fine-tuned BERT model for text classification with TensorFlow 2 and TensorFlow Hub.

Fine Tune BERT for Text Classification with TensorFlow

Sparen Sie mit 40% Rabatt auf 3 Monate Coursera Plus bei den Fähigkeiten, die Sie zum Strahlen bringen. Jetzt sparen

Fine Tune BERT for Text Classification with TensorFlow

Dozent: Snehan Kekre

19.157 bereits angemeldet

Bei enthalten

(212 Bewertungen)

Empfohlene Erfahrung

Was Sie lernen werden

Build TensorFlow Input Pipelines for Text Data with the tf.data API

Tokenize and Preprocess Text for BERT

Fine-tune BERT for text classification with TensorFlow 2 and TensorFlow Hub

Kompetenzen, die Sie festigen

- Kategorie: Model Evaluation

- Kategorie: Data Preprocessing

- Kategorie: Transfer Learning

- Kategorie: Data Pipelines

- Kategorie: Deep Learning

- Kategorie: Natural Language Processing

- Kategorie: Fine-tuning

- Kategorie: Model Training

Tools, die Sie verwenden werden

- Kategorie: Keras (Neural Network Library)

- Kategorie: Tensorflow

Wichtige Details

Zu Ihrem LinkedIn-Profil hinzufügen

Nur als Desktop-Version verfügbar

Erfahren Sie, wie Mitarbeiter führender Unternehmen gefragte Kompetenzen erwerben.

Lernen, Üben und Anwenden von berufsrelevanten Fähigkeiten in weniger als 2 Stunden

- Nehmen Sie an Schulungen von Branchenexperten teil

- Sammeln Sie mit Aufgaben aus der realen Welt praktische Erfahrung

- Schaffen Sie Vertrauen durch neueste Tools und Technologien

Über dieses begleitete Projekt

Schritt für Schritt lernen

In einem Video, das auf einer Hälfte Ihres Arbeitsbereichs abgespielt wird, führt Sie Ihr Dozent durch diese Schritte:

Introduction to the Project

Setup your TensorFlow and Colab Runtime

Download and Import the Quora Insincere Questions Dataset

Create tf.data.Datasets for Training and Evaluation

Download a Pre-trained BERT Model from TensorFlow Hub

Tokenize and Preprocess Text for BERT

Wrap a Python Function into a TensorFlow op for Eager Execution

Create a TensorFlow Input Pipeline with tf.data

Add a Classification Head to the BERT hub.KerasLayer

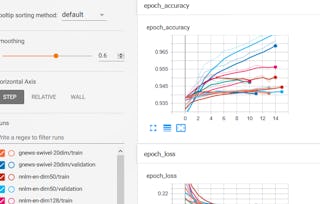

Fine-Tune and Evaluate BERT for Text Classification

Empfohlene Erfahrung

It is assumed that are competent in Python programming and have prior experience with building deep learning NLP models with TensorFlow or Keras

8 Projektbilder

Dozent

von

Was Sie beim Lernen erwartet

Auf Kompetenzen basierendes, praktisches Lernen

Üben Sie die Anwendung neuer Kompetenzen anhand von berufsbezogenen Aufgabenstellungen.

Anleitung durch Experten

Lernen Sie mit vorab von Experten aufgezeichneten Videos in einer einzigartigen aufgeteilten Oberfläche.

Keine Downloads oder Installation erforderlich

Greifen Sie in einem vordefinierten Cloud-Arbeitsbereich auf die Tools und Ressourcen zu.

Nur für Desktop verfügbar

Dieses begleitete Projekt ist für die Bearbeitung an einem Laptop oder Desktop-Computer mit stabiler Internetverbindung konzipiert und nicht für Mobilgeräte.

Warum entscheiden sich Menschen für Coursera für ihre Karriere?

Felipe M.

Jennifer J.

Larry W.

Chaitanya A.

Bewertungen von Lernenden

- 5 stars

70,75 %

- 4 stars

20,75 %

- 3 stars

4,71 %

- 2 stars

1,41 %

- 1 star

2,35 %

Zeigt 3 von 212 an

Geprüft am 19. Juni 2021

The project is very clear and easy to follow. Would suggest providing some gmail account so that we don't have to log into the colab using our own google credentials.

Geprüft am 1. Feb. 2023

it is very helpful and simply explain the idea of Bert model , really it is useful project

Geprüft am 12. Dez. 2021

Excellent and very helpful course, the instructor language is very clear and concise and to the point, I would love to learn more from the same instructor.

Ihnen könnte auch Folgendes gefallen:

Status: Kostenloser Testzeitraum

Status: Kostenloser TestzeitraumCoursera

Status: Kostenloser Testzeitraum

Status: Kostenloser Testzeitraum Status: Kostenlos

Status: Kostenlos